Как озвучить текст с помощью нейросети и не получить бездушный робо голос

Если вам знакомо, как навигатор механическим голосом произносит названия улиц с неправильным ударением, делает микропаузы вроде: «Через сто... метров», или, наоборот, «склеивает» слова, значит, озвучка в таком GPS основана на конкатенации. Суть в том, что система ищет фрагменты речи из базы и соединяет их в нужном порядке. В результате возникают подобные ляпы. А что если заменить синтезаторы на ИИ? И как озвучить текст с помощью нейросети без «синтетичности»? Об этом и пойдет речь в этой статье.

Я последовательно пройдусь по тому, как устроен синтез, какие сервисы стоит попробовать и чем они отличаются, как я на практике настраиваю диктора под разные задачи (видео, аудиокнига, подкаст, озвучка инструкций). Отдельно разберу клонирование голоса и объясню, как получать стабильный результат на длинных текстах — без «металла», скачков громкости и внезапно меняющейся интонации.

От робота к человеку: как нейросеть озвучивает текст голосом

Синтез речи — генерация человеческой речи по тексту с помощью нейросетевых моделей, которые учатся на огромных корпусах аудио и транскриптов и затем воспроизводят их с заданными параметрами.

При озвучке текста голосом нейросеть опирается на три «слоя» логики.

1. Анализ текста

Где паузы, какие слова нужно подчеркнуть, как расставить ударение, где меняется смысл. На этом этапе система часто «нормализует» текст — превращает числа, даты и сокращения в то, как их надо произнести. Например, «21.03» → «двадцать первое марта», «км/ч» → «километров в час». А еще пытается понять контекст, чтобы выбрать правильное ударение в словах-омонимах.

2. Построение акустического плана

Какой будет тембр, скорость, высота тона, интонационный рисунок, эмоциональная окраска. Многие современные TTS умеют управлять стилем речи: можно отдельно настраивать энергию (насколько речь звучит бодро), степень выразительности, а иногда даже имитировать манеру диктора.

Плюс система учитывает соседние звуки: из-за коартикуляции «съедаются» или смягчаются согласные — и хороший план заранее это моделирует.

3. Превращение «голого» плана в звук

На этом этапе работает движок TTS (Text-to-Speech), то есть генератор аудио. Финальный звук обычно создается через нейросетевой вокодер, который собирает волну так, чтобы не было роботизированного шипения. И тут важны технические детали: частота дискретизации (например, 24–48 кГц), постобработка (шумоподавление, выравнивание громкости), а также контроль артефактов — чтобы не появлялись щелчки и странные растяжения слов.

В основе — один и тот же алгоритм: глубокое обучение + статистика реальной человеческой речи. Нейросеть учится не читать, а имитировать закономерности голоса: как человек тянет гласные, как «съедает» окончания, как меняет интонацию в зависимости от типа предложения.

Почему иногда все равно слышен «робот»? Обычно дело не в сервисе, а в том, что текст написан «для глаз», а не «для ушей»: длинные канцелярские конструкции, отсутствие понятных пауз, сложная фонетика (аббревиатуры, англицизмы, фамилии), неподготовленные числа и даты. Когда я готовлю сценарий правильно, естественное звучание получается даже на среднем сервисе.

Обзор ИИ-сервисов, чтобы озвучить текст

Инструментов сейчас много: от веб-сервисов для блогеров до корпоративных API для кол-центров и ассистентов. Я делю их по задачам:

- видео и подкасты: важны эмоции, живость, стабильность темпа;

- аудиокниги и лонгриды: важна выносливость на длинном тексте и одинаковая подача;

- бизнес-интеграции: SLA, API, русский язык, управление произношением;

- быстро «озвучить документ»: удобство и скорость.

Ниже — сервисы, которые чаще всего встречаются в реальных задачах, когда нужно озвучить текст голосом ИИ без сложной студийной работы.

ElevenLabs — лидер по качеству и передаче эмоций

Если мне нужна максимально человеческая подача, я первым делом смотрю на ElevenLabs. Сильные стороны:

- очень хорошая передача эмоций и пауз;

- стабильный дикторский голос на длинных фрагментах (хотя это больше зависит от модели и тарифа);

- удобная настройка вариативности и выразительности;

- есть режимы, где можно тонко контролировать подачу и получать более живую интонацию.

ElevenLabs легко делает убедительный голос, но при плохом исходном тексте он так же уверенно озвучит ошибочную логику — например, поставит паузу не там, где надо. Поэтому я всегда предварительно редактирую текст под слух. Практический лайфхак — делить длинный материал на смысловые абзацы по 1–3 предложения и озвучивать кусками: так проще удержать единый темп, а при правках не придется пересобирать весь трек.

Часто забывают, что качественный TTS «любит» нормальную пунктуацию и явные ударения в спорных словах (фамилии, бренды, топонимы). Если этого не сделать, даже самый эмоциональный голос будет звучать неестественно именно на мелочах, которые замечают слушатели.

В рабочих задачах ElevenLabs удобен еще и тем, что можно быстро тестировать несколько вариантов подачи (чуть быстрее или медленнее, более «сухо» или более «тепло») и выбрать тот, который совпадает с жанром: реклама, интервью, объяснялка, сторителлинг. И да — если вы озвучиваете ролики, не забывайте оставлять «воздух» между фразами: потом на монтаже это спасает, когда нужно подложить музыку или вставить видеоряд.

SteosVoice (Cybervoice): звучка донатов и уникальные голоса

Знакомый многим по кибер-озвучкам SteosVoice хорош, когда нужен яркий стиль, узнаваемые голоса, быстрое производство озвучки для роликов и стримов.

Плюсы:

- много необычных голосов;

- удобен для коротких фраз, вставок, донатов;

- можно быстро получить эффектный результат без долгой возни.

Минусы:

- «пережим» по эффектности может мешать там, где нужна нейтральная дикторская подача. Для обучающих курсов и аудиокниг я бы выбирал аккуратнее.

Обычно такие «эффектные» голоса лучше всего работают в формате коротких ударных реплик: приветствие, реакция на донат, мемная вставка, анонс. Если пытаться держать на них 10–15 минут связного текста, слушатель устанет быстрее — и это не вопрос качества, просто стиль слишком «кричащий».

Полезный прием: заранее подготовить набор типовых фраз (донаты, подписки, переходы между рубриками) и держать их как библиотеку — тогда канал или стрим звучит более фирменно и узнаваемо.

Yandex SpeechKit: интеграция в бизнес, поддержка русского языка

Если задача — не просто разово озвучить, а встроить TTS в продукт (бот, IVR, приложение, сервис поддержки), я смотрю в сторону SpeechKit. Почему:

- сильная работа с русским языком;

- хорошие инструменты управления произношением;

- удобство интеграции через API;

- предсказуемость для корпоративных сценариев.

Там меньше «вау-эмоций», чем у некоторых креативных сервисов, но зато выше практическая управляемость и надежность — а бизнесу обычно нужно именно это.

В бизнес-сценариях важны не эмоции, а повторяемость: чтобы одна и та же фраза «Ваш номер заявки…» всегда звучала одинаково в понедельник и через месяц после обновлений. И SpeechKit как раз про это — про стабильность, интеграцию и контроль. Часто решающим фактором становится работа с произношением: названия товаров, артикулы, аббревиатуры, фамилии — все это можно довести до нужного звучания, иначе робот в поддержке будет регулярно «спотыкаться» на самых частых словах.

Еще один практический момент: при внедрении TTS в IVR или бота стоит заранее продумать «тон бренда» — формальный, дружелюбный, строгий — и закрепить это в шаблонах текста. Тогда даже нейтральный голос воспринимается живее: за счет правильных формулировок, длины фраз и логических пауз. В результате клиенту кажется, что система «нормально разговаривает», хотя технически это просто хорошо написанный сценарий + надежная озвучка.

Speechify: прослушивание документов и статей

Speechify я воспринимаю как прослушиватель текста, который хорошо заходит для личного потребления: статьи, PDF, заметки, учебные материалы.

Плюсы:

- удобные приложения и расширения;

- быстро озвучить и слушать на ходу;

- понятная настройка скорости.

Если нужна именно «постановочная» озвучка для публикации, я чаще беру специализированные TTS-платформы. Но для повседневной работы с текстами Speechify реально экономит время.

Самый частый сценарий — переварить большой объем чтения без выгорания: включить статью на 1.2–1.5x и пройтись по материалу как по подкасту. Это особенно полезно для учебы и работы: можно переслушивать конспекты, заметки после встреч или длинные документы перед созвоном. Еще совет из практики: если текст сложный (много терминов), лучше не гнаться за скоростью, а наоборот — чуть замедлить и разбить материал на разделы, чтобы мозг успевал «раскладывать информацию по полкам».

Пошаговое руководство: как озвучивать текст нейросетью

Далее опишу свой рабочий процесс на примере типичного веб-сервиса. Эта логика подходит и для ElevenLabs, и для аналогов.

1. Подготовка текста под слух

Я всегда делаю аудиоредактуру — превращаю письменный текст в сценарий:

- разбиваю длинные предложения. Если фраза не помещается в один спокойный вдох — слушателю будет тяжело;

- убираю канцелярит и перегруженные обороты;

- числа, даты, проценты пишу так, как это должен произнести диктор;

- расшифровываю аббревиатуры при первом появлении;

- добавляю логические паузы (иногда даже через тире или перенос строки).

Здесь важна фонетика: CRM, SaaS, фамилии, названия брендов — все это нужно привести к произношению, иначе нейросеть выдаст сюрпризы.

2. Выбор голоса и базовых параметров

Дальше выбираю голос и настраиваю основу:

- диктор: мужской или женский, возраст, стиль (нейтральный, дружелюбный, энергичный);

- тембр: у некоторых сервисов можно сделать голос теплее, ярче, ниже;

- скорость речи: почти всегда начинаю с 0.95–1.05 от «нормы»;

- выразительность: осторожно — если выкрутить слишком высоко, появляется театральность и лишние акценты.

Голос должен помогать смыслу, а не спорить с ним. Если я делаю учебный материал, выбираю спокойный, ровный дикторский голос. Для рекламных вставок — чуть больше энергии и улыбки.

3. Пунктуация, ударения и произношение

Чтобы получить естественное звучание, я отношусь к пунктуации как к нотам:

- запятая — короткая пауза;

- точка — завершение мысли, пауза длиннее;

- двоеточие — ожидание продолжения;

- тире — акцент или «разворот» фразы.

Отдельная тема — ударение. Если сервис поддерживает словарь произношений или ручные подсказки, я обязательно фиксирую спорные слова: «договор», «каталог», «маркетинг», географию, фамилии. Одно неверное ударение моментально разрушает доверие к аудио.

4. Управление эмоциями и подачей

В продвинутых платформах можно управлять тем, что я называю «режиссурой»: где улыбнуться, где снизить тон, где ускориться. Иногда это делается ползунками, иногда — специальными тегами. Если сервис поддерживает SSML-разметку, это вообще подарок: можно задавать паузы, акценты, скорость, громкость, чтение по буквам. Даже простые SSML-вставки часто спасают сложные места — особенно в инструкциях и технических текстах.

Примеры того, что я обычно регулирую:

- эмоциональная окраска: нейтрально, дружелюбно, серьезно;

- шепот (если уместно по сценарию);

- акцентирование ключевых слов;

- контроль пауз в списках и перечислениях.

Главная цель — стабильный интонационный рисунок: чтобы вступление не звучало бодро, а середина внезапно «не падала» в скуку.

5. Генерация, прослушивание, правки

Я генерирую не сразу весь текст, а блоками:

- 10–20 секунд на тест темпа и подачи;

- 30–60 секунд на проверку стабильности;

- затем уже длинные куски.

После первого прогона отмечаю места, где:

- голос «проглатывает» окончания;

- пауза не там;

- фраза звучит двусмысленно;

- слышен характерный металлический оттенок.

Часто достаточно поменять порядок слов или поставить точку вместо запятой — и подача становится живой.

6. Рендеринг и экспорт: MP3 или WAV, битрейт и финальная сборка

Формат я выбираю по задаче:

- WAV — если дальше будет монтаж, обработка, шумоподавление, музыка;

- MP3 — если нужно быстро отдать файл или загрузить на сайт.

На качество влияет битрейт. Для MP3 обычно беру 192–320 kbps: ниже иногда слышны артефакты на шипящих и в музыке. В WAV битрейт как параметр обычно не выбирается, там важнее частота дискретизации (часто 44.1/48 кГц).

После экспорта всегда слушаю итоговый микс в наушниках и на колонках: некоторые дефекты слышны только в одном сценарии. И только потом считаю, что результат готов к публикации.

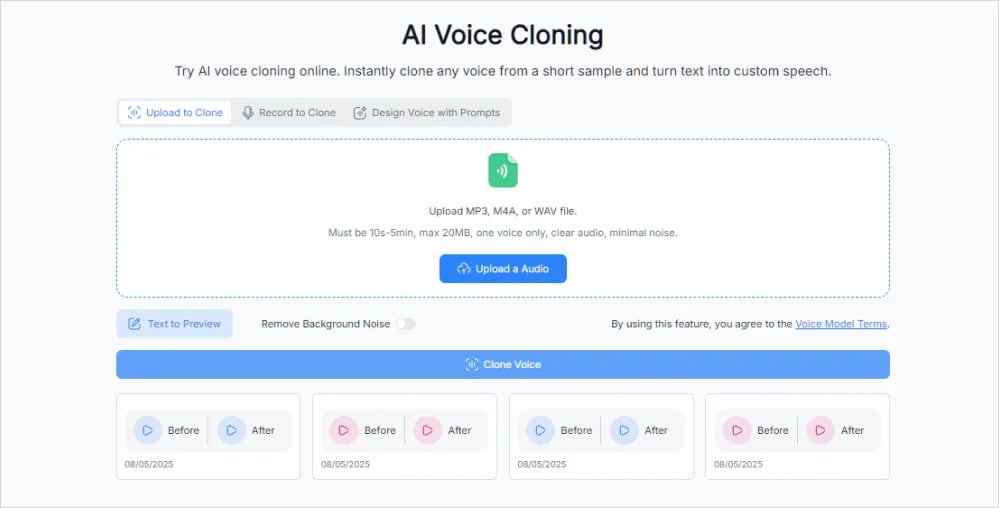

Как создать цифрового двойника по голосу: клонирование

Функция Voice Cloning сейчас стала массовой: многие сервисы позволяют обучить модель на голосе конкретного человека и получить почти тот же стиль речи, но с возможностью генерировать новые тексты.

Клон — это синтез речи, который заново произносит фразы. Поэтому он может читать то, чего вы никогда не говорили, и даже подстраиваться под темп и интонацию текста. На практике такие клоны активно используют для озвучки роликов, подкастов, курсов, автоответчиков и даже для локализации видео, когда нужно сохранить узнаваемый голос автора.

Что такое клонирование голоса на практике? Я воспринимаю это как «персональный диктор», который читает любые сценарии в том же голосе, что и исходные записи. Хороший голосовой клон — это не только тембр, но и управляемость. В некоторых сервисах можно отдельно регулировать эмоцию (спокойно или энергично), скорость, паузы и «выразительность». А еще клон иногда «наследует» речевые привычки: любимые паузы, манеру ставить ударения, характерную улыбку в голосе — и именно это делает его похожим, даже если тембр не идеален.

Вот как нейросеть обучается на коротких записях реального человека:

- записываю несколько минут чистой речи (иногда достаточно 1–5 минут, но для качества лучше больше);

- сервис анализирует особенности: темп, высоту, артикуляцию, паузы, спектр — то, что дает узнаваемый голос;

- создается модель, которую затем можно «кормить» текстом.

Качество часто упирается в разнообразие речи. Если вы читаете один абзац монотонно, модель будет сильна в «ровном дикторском» стиле, но хуже справится с вопросами, эмоциями и сложными именами. Поэтому полезно записать несколько типов фраз: нейтральные предложения, вопросы, восклицания, перечисления, даты, названия брендов и парочку длинных предложений с запятыми — так модель лучше учится паузам и мелодике.

Некоторые сервисы улучшают результат, когда вы даете короткий «референс» — пример, в каком настроении нужно произнести текст (например, бодро, доверительно или строго).

Чтобы клон был похожим и стабильным, я соблюдаю условия записи:

- тишина, минимум реверберации;

- одинаковая дистанция до микрофона;

- ровная громкость без перегрузов;

- нормальная дикция (без «съедания» окончаний).

Лучше записывать в одном и том же сетапе (тот же микрофон, наушники, комната), потому что нейросеть запоминает не только голос, но и акустику. Если пишете на телефон, старайтесь держать его одинаково и не закрывать микрофон пальцами. Идеально — записывать в 44.1/48 кГц без шумоподавления на максимум: агрессивное шумоподавление иногда съедает согласные и делает голос «пластиковым», а клон потом повторяет этот эффект.

Если исходник записан «уставшим» голосом, клон часто будет «уставшим» тоже. Нейросеть фиксирует стиль, а не только тембр. Это касается не только усталости, но и улыбки, нервозности, скорости, даже привычки «подъедать» окончания. Если вы хотите универсального диктора, полезно записывать материал в «среднем» состоянии: выспались, ровное дыхание, спокойный темп. Иногда лучше сделать две модели: одну — под официальную подачу (курсы, инструкции), вторую — более разговорную (сторис или подкаст).

Этика и безопасность

Клон — сильный инструмент, но и зона риска. Я всегда исхожу из правила: клонировать можно только свой голос или голос человека, который дал явное согласие. И если проект коммерческий, согласие лучше фиксировать письменно.

В серьезных проектах заранее прописывают, где и как клон можно использовать: например, запрет на политическую рекламу, финансовые просьбы («переведи деньги»), имитацию звонков близким. Полезно хранить исходные записи и дату согласия, чтобы при споре было что показать.

Еще одна мера — маркировка: некоторые платформы умеют добавлять «водяные знаки» в синтезированную речь или метаданные, чтобы потом было проще доказать, что аудио сгенерировано.

И наконец, стоит помнить про репутационные риски: даже «невинный» клон, попавший в чужие руки, может звучать убедительно — поэтому доступ к модели лучше защищать так же строго, как доступ к аккаунтам и платежным данным.

Популярные ИИ-инструменты для озвучки: сравнительная таблица

При выборе сервиса, меня, прежде всего, интересуют насколько хорошо звучит русский, есть ли нормальное управление произношением, можно ли делать клон, и сколько стоит производство в пересчете на объем текста. Цены и условия меняются, поэтому я укажу типичную логику: где дешевле, где дороже, и что обычно входит в бесплатный тариф.

| Сервис | Качество русского вокала | Возможность клонирования | Цена | Бесплатный тариф |

|---|---|---|---|---|

| ElevenLabs | Высокое (особенно эмоции и вариативность) | Да (в зависимости от плана/режима) | от $0 (бесплатный тариф) | Есть, ограничение — 10 000 символов, некоммерческое использование |

| SteosVoice (Cybervoice) | Среднее/хорошее (зависит от голоса) | Обычно нет или ограниченно | от $2.8 в месяц | Иногда есть демо/лимиты |

| Yandex SpeechKit | Высокое и стабильное на русском | В классическом виде — не всегда как «клон», но есть кастомизация/голоса | Часто выгодно при объеме, особенно через API | Обычно есть тестовые лимиты |

| Speechify | Хорошее для прослушивания, не всегда для продакшена | Нет/ограниченно | от $11.58 в месяц | Часто есть базовая версия |

Если мне нужно киношное ощущение и эмоции — я беру ElevenLabs. Если задача корпоративная и нужен контроль произношения на русском, выбираю SpeechKit. Если нужно быстро сделать эффектную короткую вставку — смотрю в сторону SteosVoice. А Speechify оставляю для ежедневного «озвучить и слушать», когда публиковать аудио не требуется.

Практические советы, чтобы голос звучал живо

Когда у меня просят «сделай не робот», я сначала пытаюсь понять, каким именно должен быть «живой» голос в этом контексте: спокойным и уверенным, быстрым и азартным или, наоборот, чуть задумчивым. Один и тот же текст может звучать и как дружеский разговор, и как деловая беседа. Разница — обычно не в словах, а в намерении говорящего.

Помогает сформулировать перед записью, кому вы это говорите и зачем. Если у голоса появляется адресат, интонация сама становится естественнее. Вот еще три полезных рекомендации.

- Сокращать фразы и добавляю воздух. Слишком плотный текст делает любую модель механической. Пунктуация здесь работает как режиссура: запятая делает мягкий поворот, тире — акцент, многоточие — сомнение или паузу «на подумать». Иногда достаточно заменить тяжелые конструкции на разговорные, чтобы голос перестал звучать как диктор новостей. Вместо «осуществляется» сказать «мы делаем», вместо «в дальнейшем» — «потом». Важно и то, как начинается предложение: если сразу грузить терминами, даже хороший синтез начинает звучать «канцелярски».

- Проверять сложные слова и ударение. В русском языке есть коварные случаи, когда слово знакомое, но ударение плавающее или зависит от смысла, а в именах, брендах и географии вообще легко попасть в ловушку. И еще нюанс: не только ударение выдает синтетику, но и слишком идеальная артикуляция. В живой речи мы иногда сглатываем окончания, чуть смягчаем согласные, где-то соединяем слова. Поэтому полезно перечитать текст вслух и отметить места, где язык «не ложится» — там стоит упростить формулировку или перестроить фразу.

- Выстраивать ритм. Я чередую короткие и средние предложения, добавляю логические акценты. Если каждое предложение заканчивается одинаково, голос быстро становится монотонным, даже при правильных паузах. Помогают смысловые «ступеньки»: сначала тезис, потом уточнение, затем маленький вывод — так слушатель не теряет нить. Иногда я специально добавляю микросомнение, улыбку в формулировке или легкую самоиронию, чтобы речь выглядела не как заранее выученный текст. И обязательно проверяю темп: многие «роботные» озвучки просто слишком быстрые, а снижение скорости на 5–10% неожиданно делает голос теплее.

Также я слежу за тем, чтобы интонация соответствовала жанру. Обучающий текст не должен звучать как реклама, а продающий ролик — как лекция.

FAQ

1. Какая нейросеть лучше всего озвучивает длинные тексты для аудиокниг?

Для аудиокниг я выбираю сервис по стабильности на длинных фрагментах и качеству русского произношения, предпочитая решения с тонкой настройкой стиля и словарем для фиксации произношения. Критично, как модель ведет себя с повторяющимися именами и диалогами — у некоторых TTS после первой минуты появляется «усталость» с потерей логических акцентов и странными паузами, что слушатель быстро замечает. Также важна консистентность тембра и громкости между сессиями. Поэтому я обязательно использую предпрослушивание на коротком фрагменте из середины книги, где обычно больше имен и сложных конструкций. Если там текст звучит естественно — остальное вытянется.

2. Можно ли озвучить текст с помощью нейросети бесплатно для коммерческих целей?

Иногда — да, но почти всегда коммерческое использование включено в список ограничений: лимит символов, водяные знаки, запрет или необходимость атрибуции. Для проектов на YouTube, курсов, брендов я закладываю бюджет на платный тариф, так как «коммерческое использование» трактуется шире, чем кажется — даже озвучка на канале с партнеркой или по бартеру считается монетизацией. Важно помнить, что наличие платного тарифа TTS не заменяет разрешения правообладателя на исходный текст, защищенный авторским правом.

Отдельный риск — голоса, ассоциирующиеся со знаменитостями. При жалобе их использование приведет к блокировке аккаунта. Поэтому я храню «папку проекта» со скриншотами условий тарифа, чеками об оплате, ссылками на лицензию и датами — это скучно, но выручает при возникновении вопросов у площадок или правообладателей.

3. Как убрать «металлический» призвук в голосе при генерации?

Я делаю так:

- снижаю «стабильность и вариативность» до более естественных значений (или, наоборот — в зависимости от сервиса);

- уменьшаю скорость и убираю слишком длинные предложения;

- экспортирую в WAV и уже в редакторе слегка корректирую эквалайзером (часто помогает приглушить область 4–8 кГц);

- проверяю, не слишком ли низкий битрейт у MP3: иногда артефакты — это компрессия, а не TTS.

И главное — исправляю текст под произношение. Непривычная фонетика (особенно англицизмы) часто дает «металл» и неестественные переходы.

Прием, который редко упоминают, — следить за символами и типографикой. Разные кавычки, длинные тире, «умные» пробелы, сочетания вроде «—…» или «?!» могут заставить модель делать микропаузы или, наоборот, склеивать слова. Когда модель постоянно «спотыкается», призвук становится заметнее, потому что алгоритм пытается сгладить стык. Я обычно привожу текст к одной системе: одинаковые кавычки, нормальные тире, понятные переносы и минимальное количество экзотических знаков.

Еще помогает «дыхание»: некоторые голоса звучат пластиково, потому что речь идеальна, как у диктора-робота. Если сервис позволяет добавлять естественные вдохи или микропаузу перед длинной репликой, голос становится живее, и металл уходит сам собой. В крайнем случае я делаю легкую постобработку: очень умеренная сатурация или ламповая эмуляция (буквально на несколько процентов) иногда добавляет приятные гармоники и «склеивает» звук, но важно не переборщить, чтобы не получить радиоприемник вместо чистой дикции.

4. Какие права принадлежат пользователю на сгенерированный голос?

Права зависят от условий сервиса: где-то вы получаете широкую лицензию на использование аудио, где-то есть ограничения по рекламе, политике, имитации личности. Для клонирования голоса часто требуется подтверждение согласия владельца. Важно помнить два практических нюанса:

- во-первых, вы можете использовать готовые голоса, но не всегда имеете право экспортировать их как отдельный продукт или передавать доступ подрядчику;

- во-вторых, обработка озвучки эффектами и сведением не всегда превращает ее в «новое произведение».

Для коммерческих проектов я сохраняю исходники, настройки и договоренности, а в договоре с заказчиком фиксирую, кто является лицензиатом сервиса и несет ответственность за соответствие правилам платформы — это защищает обе стороны и не оставляет исполнителя крайним при изменении условий.

5. Сколько времени занимает озвучка страницы текста?

Если «страница» — это примерно 1800–2500 знаков, генерация в большинстве сервисов занимает до двух минут, в зависимости от очереди и качества модели. Но на практике больше времени уходит на подготовку: расставить интонации, проверить ударение, настроить стиль, прослушать и внести правки. Если я делаю аккуратно, на одну страницу у меня уходит 10–25 минут, зато потом монтаж идет быстро. На сроки сильно влияет жанр и плотность смысла.

При грамотной подготовке текста и внимании к паузам, ударениям и общей подаче с ИИ-озвучкой можно получить речь, которая воспринимается как живая. Советую начинать с коротких текстов, фиксировать удачные настройки и не лениться «переписать под ухо» сложные фразы — именно это чаще всего дает лучший эффект. Если вы еще решаете, как озвучить текст нейросетью, попробуйте 2–3 сервиса и сравните не по «красоте голоса», а по тому, насколько легко вам управлять смыслом и интонацией.

Если хотите, в комментариях я отвечу, какой сервис лучше подойдет под вашу задачу (аудиокнига, ролики, обучение, бизнес), и помогу оценить текст перед генерацией.

Комментарии к статье

Пока нет комментариев. Будьте первым!