Виды нейросетей: какие бывают архитектуры и чем они отличаются

Что такое нейросеть?

Нейросеть — это математическая модель, которая имитирует работу нейронных связей мозга и учится находить закономерности в данных без заранее прописанных правил. Я воспринимаю ее не как «умную программу», а как систему весов и связей, которые постепенно подстраиваются под задачу на основе ошибок и обратной связи. В отличие от классических алгоритмов, нейронка не ищет решение по жесткому сценарию, а формирует его сама, опираясь на статистику и структуру входной информации. Именно поэтому одни модели хорошо справляются с изображениями, другие — с текстами или временными рядами, а третьи — с генерацией нового контента, который не повторяет обучающие данные буквально.Какие бывают виды нейросетей?

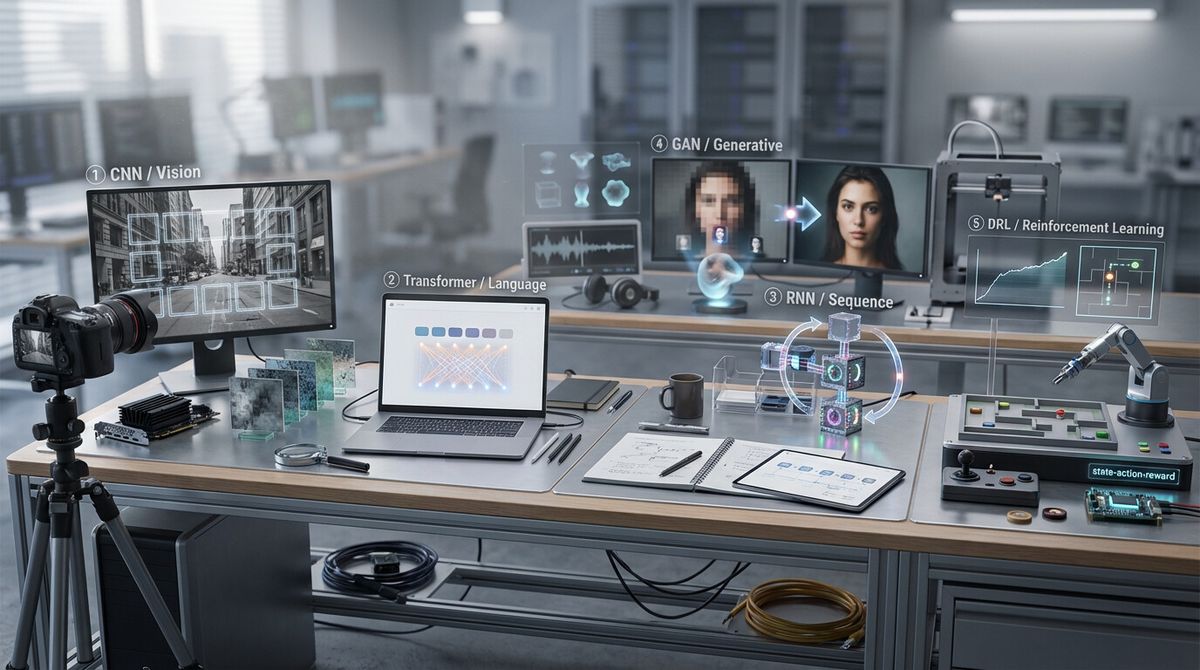

Я познакомлю вас с 5 видами нейросети. У каждого типа архитектуры — свой круг задач в зависимости от структуры данных и способа их обработки. Я обычно делю их по принципу работы с информацией: одни лучше понимают последовательности, другие эффективно анализируют изображения, третьи подходят для базовых предсказаний и классификации. Ниже разберу ключевые виды нейросетей, с которыми чаще всего сталкиваются на практике.Трансформеры

Архитектура, которая полностью изменила работу с последовательными данными. В отличие от RNN, они не обрабатывают вход по одному элементу за раз, а оценивают весь контекст сразу с помощью механизма self‑attention. Это позволяет моделям захватывать долгие зависимости в тексте и быстро масштабироваться. Именно на трансформерах базируются современные большие языковые модели, такие как GPT‑4, которые обучаются на триллионах токенов и оперируют контекстом длиной в десятки тысяч символов.

Такой ИИ применяют для машинного перевода, автоматических диалоговых систем, семантического поиска и генерации логичных текстов, а также для анализа аудио и кода — все это задачи, где нужно учитывать глобальные связи в данных.

Рекуррентные сети (RNN)

Рекуррентные нейросети появились как естественное решение для последовательных данных: каждое новое состояние зависит от предыдущего. Модификации RNN, такие как LSTM и GRU, решают проблему исчезающего градиента, благодаря чему способны запоминать информацию на сотни и тысячи шагов. Эти сети традиционно используются для обработки речи (ASR), прогнозирования временных рядов, например, финансовых показателей, где значение в текущий момент зависит от прошлых наблюдений, а также для языковых задач средней длины, где порядок слов влияет на смысл. Тем не менее, по сравнению с трансформерами, RNN медленнее масштабируются на длинные последовательности и реже используются в больших моделях.Сверточные сети (CNN)

Сверточные нейросети — стандарт де‑факто при работе с изображениями и видео. Их ключевым элементом считаются свертки, которые проходят по пикселям, выделяя локальные признаки: края, углы, текстуры. Эти признаки затем комбинируются на более высоких уровнях для обучения сложных представлений. CNN доказали свою эффективность в задачах распознавания лиц (до 99% точности в стандартизированных датасетах), классификации медицинских снимков (эксперт‑уровень в диагностике пневмонии и рака), детекции объектов на видеопотоке и выявления дефектов на производстве. Их архитектуры, например, ResNet, Inception, EfficientNet, стали основой для конкурсов, включая ImageNet, где точность классификации превышает 85–90% даже для тысяч классов.

Полносвязные сети (Feedforward)

Полносвязные сети — это простейший вид нейросетей, где каждый нейрон на слое соединен со всеми нейронами на следующем. Они особенно полезны для классификации и регрессии, когда данные представлены числовыми признаками без явной структуры, например, показатели клиента для кредитного скоринга или характеристики датчиков для предсказания отказа оборудования. Такие сети хорошо работают, когда зависимость между признаками и целевым выходом нелинейная, но сама структура данных не требует учета порядка или местоположения элементов. Feedforward‑модели часто служат базовой отправной точкой: если они дают низкую точность, следующим шагом становятся более сложные архитектуры.Многослойные перцептроны (MLP)

Многослойные перцептроны — это разновидность полносвязных сетей с несколькими скрытыми слоями. Они способны выучивать более сложные зависимости, чем простые линейные модели, но при этом остаются относительно легкими в обучении. В реальных задачах MLP применяют для рекомендательных систем, где нужно моделировать предпочтения пользователя на основе множества факторов, финансового прогнозирования с большим числом коррелирующих переменных, а также предобработки табличных данных перед передачей в более сложные модели. Их сильная сторона — гибкая аппроксимация взаимосвязей без необходимости специальной обработки структуры данных, будь то изображение или временной ряд.Техногиганты и их проекты

Передовые компании в этом направлении перешли от теории к практике. Искусственный интеллект вошел в продукты, которыми мы пользуемся ежедневно: от генерации текста до голосовых помощников и поиска. Но у каждой компании индивидуальный путь и свои сильные стороны. Ниже я разберу ключевых игроков, их проекты и стратегии.OpenAI

OpenAI — это, пожалуй, имя, которое ассоциируется с нейросетями у большинства людей. Компания вошла в массовый обиход благодаря серии трансформерных моделей GPT (Generative Pretrained Transformer). Они умеют генерировать связный текст, отвечать на вопросы, писать код и даже участвовать в диалоге. Кроме GPT, OpenAI разработала системы вроде DALL-E и CLIP: первые — для создания изображений по описанию, вторые — для взаимосвязи текста и картинок. Codex — вариант GPT, заточенный под понимание и написание программного кода. Особенность OpenAI в том, что ее модели приводят в работу самые разные задачи и форматы данных без ручной настройки под каждую конкретную область. В результате эти AI применяют для генерации контента, поддержки клиентов, автоматизации бизнес-процессов, написания приложений и обучения.

Google считается одним из лидеров ИИ не только за счет своих трансформерных моделей, но и благодаря глубоким исследованиям и разнообразным продуктам. Одна из таких моделей — BERT, которая научила системы лучше понимать контекст текста в обе стороны, что важно для поиска, классификации и извлечения сущностей. Кроме BERT, Google развивает T5, а также мультимодальную семью моделей под брендом Gemini, которые обрабатывают одновременно текст, изображения и другие типы данных. Еще одно направление — проекты DeepMind, такие как AlphaGo и AlphaFold. Они показывают, что нейросети способны решать задачи вне классического «обработки текста или изображения»: AlphaGo побеждает у чемпионов по стратегии, а AlphaFold помогает предсказывать структуру белков, что критично для науки и медицины.

Microsoft

Microsoft делает ставку на то, чтобы нейросети работали в продуктах, которыми пользуются компании и профессионалы. Через Azure AI компания предлагает платформу для обучения, развертывания и масштабирования моделей для анализа текста, речи и изображений. Еще одна важная часть экосистемы Microsoft — интеграция ИИ-ассистентов в самые разные сервисы: Copilot помогает писать тексты, анализировать данные и автоматизировать задачи в Microsoft 365. Microsoft также активно сотрудничает с OpenAI и участвует в глобальных инициативах по безопасному развитию ИИ, подписав соответствующие соглашения с другими крупными компаниями.

Yandex

Яндекс делает нейросети частью повседневных сервисов и интерфейсов. Компания развивает YandexGPT, который умеет обрабатывать и генерировать текст по-русски, помогая с ответами на вопросы, поиском и задачами классификации. У компании есть и система генерации изображений YandexART, которая по описанию создает изображения и анимации, а также множество моделей для поиска, рекомендаций и голосовых интерфейсов. Акцент здесь сделан на интеграции нейросетевых возможностей в те продукты, которые уже используются миллионами: поиск, навигация, голосовой помощник и сервисы уюта цифрового дня.

Sber

Сбер развивает собственную линейку нейросетевых решений под брендом Sber AI. В ее рамках есть GigaChat — языковая модель для работы с русскоязычным контентом, анализом и генерацией текста, а также Салют — голосовой ассистент для взаимодействия с пользователем. Помимо этого, нейросети Сбера умеют генерировать изображения (Kandinsky) и решают задачи анализа речи и синтеза. Интересная особенность — ориентация на локальный рынок и масштабное применение в B2B-сегменте, что делает эти ИИ-сервисы удобными для российских компаний.

Apple

Apple традиционно развивает AI внутри своих устройств, делая акцент на приватности и скорости обработки данных без передачи их в облако. Для этого компания создала Neural Engine, специализированные чипы, оптимизированные под нейросетевые вычисления, которые используются в Face ID, улучшении фото и видео, распознавании речи и прочих задачах. Apple заключила соглашение с OpenAI и интегрировала технологии GPT-4o в свою систему Apple Intelligence. Эта платформа расширяет привычные функции: она может переписывать текст сообщений, приоритизировать уведомления и письма на iPhone и iPad, а также использовать нейросетевые функции для редактирования фото, например, удалять объекты или создавать интерактивные «воспоминания» из снимков и видео.

Нишевые разработчики

Небольшие организации играют не меньшую роль, чем техногиганты, хотя работают в более узких направлениях. Я выделяю их в отдельную группу, потому что именно такие компании часто двигают конкретные виды нейронок вперед, быстрее экспериментируют с архитектурами и задают тренды, которые позже подхватывают крупные экосистемы.Stability AI

Британская компания, наиболее известная благодаря модели Stable Diffusion для генерации изображений по текстовым описаниям. Это одна из первых диффузионных нейросетей, получившая широкое распространение и доступ с открытым исходным кодом, что дало толчок развитию генеративного AI-сообщества в целом. Stable Diffusion и ее семейство моделей используются для создания детализированных иллюстраций, редактирования изображений, Inpainting/Outpainting и творческих экспериментов. Сейчас существуют несколько поколений моделей, включая версии с оптимизированными весами для быстрого запуска даже на домашнем железе. Новые разработки, такие как Stable Cascade, обеспечивают более экономный расход вычислительных ресурсов, снижая нагрузку на обучение до 16 раз по сравнению с базовыми вариантами, и позволяют генерировать вариативные изображения и творчески перерабатывать контент. Кроме того, Stability AI развивает модели для музыки и аудио, например, Stable Audio Open 1.0, которая способна генерировать длительные музыкальные дорожки и звуковые эффекты в различных жанрах от электронных треков до кинематографического саундтрека.

Kuaishou

Китайская компания, чей основной фокус не просто на моделях, а на видео- и мультимодальных AI-продуктах. Инструменты этой платформы анализируют кадры, действия и контекст видео в реальном времени, что позволяет автоматизировать монтаж, адаптацию форматов и создание персонализированного контента. Kuaishou представила несколько AI-функций для переработки видео, включая технологию outpaint на движущихся кадрах: ИИ может достроить недостающие элементы сцены за пределами исходного кадра, что ранее требовало ручного редактирования в профессиональных редакторах.

Luma AI

Организация делает ставку на нейросетевую 3D-реконструкцию: модели компании умеют строить трехмерные сцены из 2D-фото и видео. Это направление базируется на нейронном рендеринге и специализируется на глубине, освещении и текстурах объекта. У Luma есть решения типа Reframe, позволяющие не только трансформировать объекты внутри сцены, но и адаптировать видео под разные форматы без ручной доработки. Эти инструменты активно применяют креаторы рекламы, архитекторы, разработчики игр и режиссеры, которым нужно быстро получить реалистичный 3D-контент из обычных кадров.

Anthropic

Компания фокусируется на языковых ИИ, безопасных и предсказуемых в работе. Их семейство моделей Claude известно расширенным контекстным окном, например, отдельные версии способны оперировать с миллионом токенов, что намного больше, чем у многих других LLM. Это позволяет анализировать длинные документы, большие отчеты и комплексные сценарии, сохраняя последовательность и логику ответа. Anthropic постоянно обновляет свои модели, расширяет возможности понимания и генерации текста, а также внедряет механизмы контроля поведения нейронок, чтобы они реже ошибались в ответах на сложные и неоднозначные запросы.

Hugging Face

Фактически крупнейший центр экосистемы открытых ИИ. На платформе размещено более 1 миллиона моделей, датасетов и приложений, что отражает экспоненциальный рост сообщества AI-разработчиков. Платформа стала для многих разработчиков тем, чем GitHub стал для open-source разработки ПО: здесь публикуют веса моделей, проводят обучение, делятся инструментами и даже разворачивают готовые решения. Среди проектов на Hugging Face можно найти все — от языковых LLM до специализированных моделей для анализа изображений, аудио- и мультизадачных рабочих процессов. Сама компания привлекла значительные инвестиции и оценивается в несколько миллиардов долларов, что показывает стратегическое значение открытых моделей в современной AI-индустрии.

Transformers

Хотя трансформеры — это архитектура, они также представлены как инструментарий в рамках экосистемы, особенно через библиотеку Transformers от Hugging Face. Эта библиотека стандартизировала работу с моделями типа BERT, GPT, T5 и другими, что упростило разработку, обучение и внедрение моделей. Ее использование очень широко: от классификации текста и перевода до генерации ответов и создания ассистентов. Благодаря доступности и большому количеству предобученных моделей, трансформеры стали доминирующей архитектурой для языковых LLM и мультимодальных систем.

Diffusers

Специализированный фреймворк для диффузионных моделей, которые применяются в генерации изображений и видео. Эти инструменты позволяют тонко управлять процессом перехода от шума к финальному изображению, настраивать стиль, разрешение и параметры вывода. Такие решения особенно интересны дизайнерам, визуальным артистам и исследователям, поскольку дают детализацию и контроль над результатом, что невозможно при простых генераторах black-box.

Mistral

Французский стартап, основанный выходцами из DeepMind и Meta*. Компания быстро привлекла внимание инвесторов: в сериях финансирования она получила более $1 млрд, а оценка бизнеса перевалила за $10–14 млрд, став крупнейшим AI-стартапом в Европе. Mistral создает компактные, но мощные языковые модели, которые запускаются на более доступном железе, сохраняя высокую производительность. Они ориентированы на корпоративное использование, автоматизацию общения с клиентами, аналитические задачи и интеграцию в бизнес-приложения.

Преимущества и недостатки нейросетей

Нейросети стали неотъемлемой частью современных технологий, и их возможности впечатляют: они умеют писать тексты, создавать изображения, анализировать данные и даже помогать в научных исследованиях. Но, как и любой инструмент, AI-помощники имеют свои сильные и слабые стороны. Понимание этих особенностей важно, чтобы грамотно использовать модели в работе или творчестве и минимизировать риски.| Преимущества | Недостатки |

| Автоматизация рутинных задач — AI способны выполнять повторяющиеся операции быстрее человека, от анализа данных до генерации контента. | Галлюцинации — иногда модели создают ответы, которые кажутся правдоподобными, но на самом деле неверны. Это происходит из-за стремления модели искать закономерности в огромных объемах данных, даже если факты противоречат реальности. |

| Обработка больших объемов информации — нейронки способны одновременно анализировать сотни тысяч документов, изображений или сигналов. | Зависимость от данных — качество и точность работы нейросети сильно зависят от обучающих наборов. Ошибки и пробелы в данных отражаются на результатах. |

| Поддержка творчества и разработки — генерация текста, изображений и кода помогает создавать прототипы, иллюстрации и идеи быстрее. | Ограниченная интерпретируемость — модели часто работают как черный ящик, и сложно понять, почему они приняли именно такое решение. |

| Скорость и масштабируемость — ИИ легко масштабируются под большие нагрузки и могут работать 24/7 без усталости. | Потенциальная предвзятость — модели могут отражать или усиливать скрытые предубеждения, присутствующие в обучающих данных. |

| Универсальность — одна нейросеть может решать множество задач: от перевода и распознавания речи до анализа медицинских изображений. | Высокие вычислительные требования — особенно для больших моделей, что требует мощного оборудования и затрат на обслуживание. |

FAQ

1. Какие существуют основные типы нейросетей?

Существуют несколько ключевых типов нейронок, которые различаются по архитектуре и способу обработки данных. Основные: многослойные перцептроны (MLP), сверточные нейросети (CNN) для работы с изображениями, рекуррентные сети (RNN) для последовательных данных, трансформеры для текста и мультимодальных задач, а также полносвязные сети (Feedforward). Каждая архитектура создавалась для решения определенных задач, хотя со временем границы применения размываются.2. В чем разница между сверточными и рекуррентными нейросетями?

Сверточные нейросети предназначены для обработки данных с пространственной структурой, например, изображений. Они эффективно выявляют локальные закономерности, такие как грани, текстуры и формы. Рекуррентные сети ориентированы на последовательные данные — тексты, аудио, временные ряды. Их особенность в том, что они учитывают предыдущие элементы последовательности, сохраняя контекст. Простыми словами, CNN «смотрят на картинку», а RNN «слушают историю» и анализируют последовательность событий.3. Для каких задач подходят разные виды нейросетей?

- CNN — обработка изображений, видео, медицинских сканов, распознавание объектов.

- RNN и LSTM — тексты, речь, временные ряды, прогнозирование последовательностей.

- Трансформеры — машинный перевод, чат‑боты, генерация текста, мультимодальные задачи.

- MLP и Feedforward — задачи классификации, регрессии и простых предсказаний, где данные не имеют явной последовательной или пространственной структуры.

4. Что такое сверточная нейросеть и где она используется?

Сверточная нейросеть — это модель, которая с помощью фильтров выявляет локальные признаки данных. В основном ее используют для обработки изображений и видео. Примеры применения: распознавание лиц и объектов, медицинская диагностика, автоматическая обработка фото и видео, генерация изображений.5. Какие нейросети лучше всего работают с последовательными данными?

Для последовательных данных оптимальны рекуррентные сети и трансформеры. Они учитывают порядок элементов и контекст, что важно для текста, аудио и любых временных рядов. Трансформеры чаще применяются для сложных текстовых задач и больших объемов данных, а RNN — для коротких последовательностей и задач с ограниченными ресурсами.6. Что такое генеративно-состязательная сеть (GAN) и чем она отличается от других?

GAN — это сеть, состоящая из двух моделей: генератора, который создает данные, и дискриминатора, который оценивает, насколько они реалистичны. Они «соревнуются», и в процессе обучения генератор становится все точнее. Главное отличие GAN от других моделей в том, что она предназначена именно для производства новых данных — изображений, видео, музыки — а не только для анализа или классификации.7. Как выбирать тип нейросети под конкретную задачу?

Выбор зависит от типа данных и цели:- Изображения и видео → CNN.

- Тексты, речь, последовательности → RNN, LSTM, трансформеры.

- Простые структурированные данные → MLP, Feedforward.

- Генерация новых объектов → GAN, диффузионные модели.

Комментарии к статье

Пока нет комментариев. Будьте первым!