Локальные нейросети: зачем устанавливать ИИ на компьютер и кому это реально нужно

Мы живем в эпоху, когда ChatGPT и Midjourney стали привычными инструментами миллионов людей — но за удобство облачных сервисов приходится платить не только деньгами, но и приватностью, зависимостью от серверов и жесткими ограничениями контента. Локальные нейросети предлагают радикально иной подход: модель работает на вашем ПК, ваши данные не покидают жесткий диск, а ограничения устанавливаете только вы сами.

В этой статье я последовательно отвечу на главные вопросы: зачем переходить на локальный запуск, какое железо реально необходимо, как без головной боли установить ИИ на компьютер, какие инструменты и модели сейчас лучшие, как настроить автоматизацию через локальный ИИ агент, ускорить работу через квантование и защитить бизнес-данные.

Локальный ИИ против облаков: в чем смысл запуска нейросети на своем ПК

Казалось бы, облачные решения удобны: зашел на сайт, ввел промпт, получил ответ. Зачем усложнять жизнь? Но как только начинаешь работать с ИИ серьезно — в бизнесе, в исследованиях, в творческих проектах — облако начинает трещать по швам.

Первая и главная проблема — приватность. Любой запрос к ChatGPT, Claude или Gemini формально обрабатывается на серверах компании и может быть использован для дообучения модели или проверки модераторами. Для корпоративных задач, юридических документов, медицинских данных или просто конфиденциальной переписки это неприемлемо.

Вторая проблема — цензура и ограничения контента. Облачные модели обучены отказывать в определенных типах запросов: написать жесткую сцену для романа, сгенерировать специфический контент для взрослых, дать подробный технический ответ на «чувствительную» тему. Отсутствие цензуры (Uncensored) — одно из главных преимуществ локального запуска, поскольку вы сами решаете, какие фильтры применять к модели.

Третья проблема — зависимость от интернета и доступности сервиса. Сервера падают, API-лимиты заканчиваются, подписки дорожают. В марте 2023 года сервисы OpenAI были недоступны несколько часов — и тысячи команд просто потеряли рабочий день. ИИ на ПК работает офлайн, 24/7, без абонентской платы.

Четвертая проблема — стоимость. Активное использование GPT-4 через API обходится в десятки, а иногда и сотни долларов в месяц. Одноразовые затраты на хорошую видеокарту окупаются за несколько месяцев интенсивной работы.

Наконец, открытый исходный код (Open Source) локальных моделей означает, что вы можете изучить, как именно работает модель, дообучить ее на своих данных, встроить в собственные приложения и не зависеть от решений одной корпорации.

Какие характеристики ПК нужны для стабильной работы нейросети

Прежде чем качать модели и ставить фреймворки, нужно честно оценить свое железо. Именно здесь большинство новичков допускают главную ошибку: смотрят на параметры процессора, тогда как для нейросетей критичны совсем другие характеристики.

Видеокарты и объем VRAM: почему это критично

Видеопамять (VRAM) — это важнейший параметр для запуска языковых и графических моделей. Если модель не помещается в видеопамять, часть ее данных выгружается в оперативную память, что значительно замедляет работу. Для эффективного запуска моделей с большим количеством параметров необходима видеокарта с 8 ГБ VRAM (для моделей около 7 миллиардов параметров) и более, а для работы с более сложными моделями и графикой — 12-16 ГБ VRAM.

Грубое правило такое: каждый миллиард параметров модели занимает примерно 2 ГБ VRAM в 16-битной точности, и около 0,5–1 ГБ — в 4-битном квантовании. Таким образом, с 8 ГБ VRAM можно комфортно запустить модель на 7–8 миллиардов параметров в квантованном виде, а с 16 ГБ — уже на 13–14 миллиардов.

Производительность при вычислениях на GPU определяется в том числе количеством ядер CUDA (для видеокарт NVIDIA) — именно они выполняют параллельные матричные вычисления, лежащие в основе инференса. В современных картах серии RTX 4000/5000 также присутствуют тензорные ядра — специализированные блоки для операций с матрицами низкой точности (FP16, INT8, INT4), что дополнительно ускоряет работу с квантованными моделями в разы.

Отдельно стоит упомянуть NPU (Neural Processing Unit) — нейрочип, встроенный в современные процессоры Intel Core Ultra, AMD Ryzen AI и Apple Silicon. Он специально создан для ускорения операций машинного обучения и позволяет разгрузить основной GPU при определенных задачах. Пока что поддержка NPU в популярных локальных инструментах ограничена, но тренд очевиден: в 2025–2026 годах интеграция нейрочипов в экосистему локального ИИ заметно ускорилась.

Если коротко о рекомендуемых конфигурациях GPU:

- 8 ГБ VRAM (RTX 3070/4060 Ti и аналоги) — базовый уровень, подходит для моделей 7B в Q4–Q5 квантовании, а также для Stable Diffusion.

- 12–16 ГБ VRAM (RTX 3080/4070/4080) — комфортный уровень для моделей 13B, сложных графических пайплайнов, SDXL.

- 24 ГБ VRAM (RTX 3090/4090) — профессиональный уровень, позволяет запускать модели 34B и частично 70B в агрессивном квантовании.

- 48+ ГБ VRAM (профессиональные карты типа RTX A6000, H100) — серверный класс, полные версии крупных моделей без квантования.

Процессоры и оперативная память для инференса на CPU

Если подходящей дискретной видеокарты нет — не беда. Инференс (Inference) на CPU возможен, но это значительно замедлит процесс. Для обработки крупных моделей, таких как GPT-4 или большие графические сети, использование CPU будет крайне неэффективным из-за значительно более медленной работы по сравнению с GPU. Здесь в игру вступают тактовая частота, количество ядер и, критически, скорость оперативной памяти.

Современная оперативная память DDR5 с высокой частотой (5600–7200 МГц) значительно ускоряет инференс на CPU по сравнению с DDR4, но даже с такой памятью процессорный инференс будет в несколько раз медленнее, чем на GPU. Для более быстрого выполнения инференса с большими языковыми моделями необходима мощная видеокарта. При работе только на CPU рекомендуется иметь минимум 32 ГБ RAM, а лучше 64 ГБ для крупных моделей.

Хорошая новость: фреймворк llama.cpp (лежащий в основе многих популярных инструментов) умеет распределять нагрузку между CPU и GPU одновременно — этот режим называется нейронный движок в контексте гибридного инференса. Если у вас слабая видеокарта с 6 ГБ VRAM и мощный процессор с 32 ГБ RAM, часть слоев модели будет обрабатываться на GPU, остальные — на CPU. Скорость будет ниже полноценного GPU-режима, но всяко лучше чистого CPU.

Софт для ИИ: установка нейросети на ПК без навыков программирования

Еще два года назад развернуть локальную языковую модель означало часы в командной строке, зависимости Python, конфликты версий и ответы на Stack Overflow. Сегодня ситуация кардинально изменилась.

Самый простой способ установить ИИ на компьютер без единой строчки кода — использовать Pinokio. Это графический лаунчер с магазином приложений, который одним кликом скачивает, устанавливает и запускает любой популярный AI-проект: Stable Diffusion WebUI, ComfyUI, Text Generation Web UI, KoboldAI и десятки других. Pinokio сам разворачивает окружение Python, устанавливает зависимости и запускает веб-интерфейс — пользователю остается только нажать кнопку.

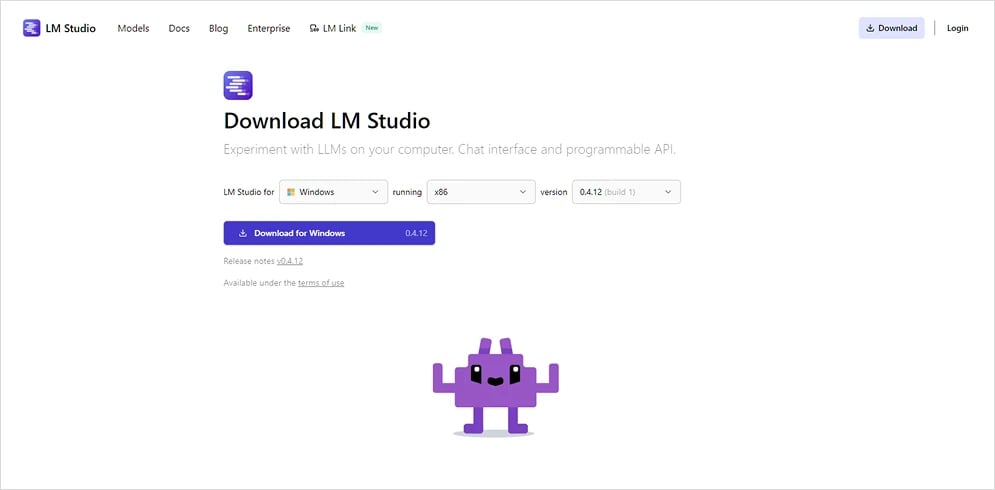

Второй вариант — LM Studio, настольное приложение под Windows, macOS и Linux с интуитивным интерфейсом. Встроенный поисковик подключается к Hugging Face (крупнейшему репозиторию открытых моделей) и позволяет в два клика скачать нужную модель прямо из приложения, не открывая браузер.

Для тех, кто не боится терминала, Ollama предлагает элегантное CLI-решение: одна команда ollama run llama3 скачивает модель и сразу запускает чат. Это примерно как pip install, только для нейросетей.

Важный момент: все три инструмента работают с форматом GGUF — это стандартный формат квантованных моделей, который обеспечивает совместимость между разными фреймворками. Скачал модель в GGUF — запускай хоть в LM Studio, хоть в KoboldAI, хоть в Text Generation Web UI.

Второй способ установить ИИ на компьютер — зайти на Hugging Face и скачать готовую модель вручную. На платформе доступны сотни тысяч моделей с открытым исходным кодом, включая официальные веса архитектуры Llama 3 от Meta и модели Mistral от Mistral AI — двух самых популярных семейств для локального запуска.

Инструменты для локального ИИ: лучшие решения для текста и графики на ПК

Выбор инструмента — это 80% успеха: хороший интерфейс экономит часы настройки, а поддержка GGUF и удобный импорт моделей с Hugging Face превращает сложный процесс в пару кликов. Так какие ИИ на ПК использовать в 2026 году?

1. KoboldAI

Один из старейших и наиболее зрелых инструментов для запуска текстовых языковых моделей локально, изначально заточенный под интерактивное повествование, ролевые игры и написание художественных текстов. Интерфейс ориентирован на писателей: здесь есть инструменты для управления «памятью» персонажей, историей мира и контекстом сюжета. KoboldAI поддерживает режим без цензуры, что делает его фаворитом среди создателей художественного контента.

Основные возможности:

- Поддержка большого числа форматов моделей, включая GGUF и GPTQ.

- Встроенный редактор историй с управлением памятью и примечаниями.

- Режим совместного написания с ИИ в реальном времени.

- API-совместимость для подключения внешних клиентов.

- Поддержка персонажных карточек и пресетов поведения модели.

2. ComfyUI

Мощный редактор для генерации изображений на базе Stable Diffusion и других диффузионных моделей. В отличие от линейных интерфейсов, ComfyUI позволяет выстраивать сложные визуальные пайплайны: соединять модели, контролирующие сети (ControlNet), апскейлеры, маскирование и постобработку в единую схему, как в Blender или After Effects. Это инструмент для тех, кому нужен полный контроль над процессом генерации — не «нажми кнопку», а «построй машину».

Основные возможности:

- Нодовый визуальный редактор пайплайнов генерации изображений.

- Поддержка SDXL, Flux, SD 1.5, а также видеогенерации (AnimateDiff).

- Встроенная поддержка ControlNet, IP-Adapter, LoRA-адаптеров.

- Сохранение и импорт пайплайнов в виде JSON-файлов.

- Активная экосистема кастомных нодов от сообщества.

3. Ollama

Минималистичный, но невероятно мощный инструмент для запуска локального LLM через командную строку и REST API. Принцип работы максимально прост: одна команда в терминале запускает нужную модель, которая тут же доступна через локальный API. Ollama прекрасно интегрируется с Open WebUI, AnythingLLM и другими графическими оболочками, а также с фреймворками LangChain и LlamaIndex для построения агентских систем.

Основные возможности:

- Однострочная установка и запуск любой модели из каталога.

- Встроенный REST API, совместимый с форматом OpenAI.

- Поддержка мультиплатформенности: Windows, macOS, Linux.

- Горячее переключение между моделями без перезапуска.

- Поддержка мультимодальных моделей (текст + изображение).

4. GPT4All

Пожалуй, самый «народный» инструмент для знакомства с локальными языковыми моделями: простое настольное приложение с чатом, встроенным магазином моделей и поддержкой работы с локальными документами. Никаких API, никаких настроек — скачал, запустил, общаешься. GPT4All ориентирован на обычных пользователей, а не на разработчиков, и прекрасно справляется с задачами ответов на вопросы, суммаризации и работы с личной базой знаний.

Основные возможности:

- Простой чат-интерфейс без технических настроек.

- Встроенный каталог популярных моделей с одним кликом для скачивания.

- Режим LocalDocs: загрузка PDF и текстовых файлов для работы с вашими документами.

- Поддержка GPU-ускорения (NVIDIA и AMD).

- Офлайн-режим после первоначальной загрузки модели.

5. InvokeAI

Профессиональная платформа для генерации изображений на базе Stable Diffusion с упором на художников и дизайнеров. В отличие от конкурентов, InvokeAI предлагает продуманный UX: удобный холст для инпейнтинга и аутпейнтинга, управление историей генераций, тонкую настройку параметров. Инструмент активно развивается и поддерживает последние архитектуры моделей, включая Fooocus-совместимые конфигурации.

Основные возможности:

- Профессиональный холст для рисования, инпейнтинга и расширения изображений.

- Управление коллекцией моделей и LoRA-адаптеров.

- Встроенная поддержка ControlNet и IP-Adapter.

- История генераций с возможностью возврата к любому шагу.

- Поддержка SDXL и современных диффузионных моделей.

6. Stable Diffusion Web UI

Стандарт среди инструментов для локальной генерации изображений. Огромное сообщество, тысячи расширений, совместимость с любыми чекпоинтами и LoRA, детальные настройки семплеров — все это делает его незаменимым для тех, кто серьезно занимается AI-арт-генерацией. Интерфейс браузерный, настройки — практически неограниченные.

Основные возможности:

- Поддержка всех популярных форматов моделей: SafeTensors, CKPT, LoRA, LyCORIS.

- Более тысячи расширений от сообщества, включая upscaler, детектор лиц, анимацию.

- Img2img, инпейнтинг, outpainting, ControlNet — все в одном интерфейсе.

- Детальное управление параметрами семплирования и шагами генерации.

- Поддержка скриптов для пакетной обработки и автоматизации.

7. LM Studio

Лучший выбор для тех, кто хочет начать работу с локальными языковыми моделями максимально быстро и без стресса. Это настольное приложение с красивым интерфейсом, встроенным поисковиком по Hugging Face, поддержкой GGUF-моделей и локальным сервером OpenAI-совместимого API. LM Studio позволяет прямо в интерфейсе сравнивать разные модели, настраивать системные промпты, регулировать контекстное окно и отслеживать скорость генерации в токенах в секунду (t/s).

Основные возможности:

- Встроенный магазин моделей с прямым подключением к Hugging Face.

- Локальный сервер, совместимый с OpenAI API — для подключения любых приложений.

- Отображение технических метрик в реальном времени: t/s, загрузка VRAM, температура.

- Поддержка мультиплатформенности с оптимизацией под Apple Silicon (Metal).

- Гибкая настройка контекстного окна и параметров генерации.

8. DeepFaceLab

Специализированный инструмент для замены лиц (deepfake) на видео, широко используемый в кино, постпродакшене, образовании и исследованиях компьютерного зрения. Это один из немногих инструментов своего класса с реально открытым исходным кодом и активной поддержкой сообщества. Работает полностью локально — данные не покидают ваш ПК.

Основные возможности:

- Высококачественная замена лиц на видео с сохранением мимики и освещения.

- Поддержка различных архитектур модели: SAEHD, Quick96, XSeg.

- Пакетная обработка видеофайлов на GPU.

- Инструменты для точной разметки и сегментации лица.

- Активное сообщество с готовыми пресетами и туториалами.

9. Text Generation Web UI

Своеобразный «швейцарский нож» среди локальных текстовых фреймворков. Поддерживает огромное количество бэкендов (llama.cpp, ExLlama, Transformers, AutoGPTQ), режимы чата, ролевых игр, completion API и даже расширения на Python. Это инструмент для продвинутых пользователей, которые хотят максимальную гибкость и экспериментируют с разными моделями и методами инференса.

Основные возможности:

- Поддержка множества бэкендов: llama.cpp, ExLlama2, Transformers, AutoGPTQ.

- Режимы chat, instruct, notebook и completion в одном интерфейсе.

- Система расширений на Python для добавления любой функциональности.

- Интеграция с векторными базами данных для RAG-пайплайнов.

- Полный контроль над параметрами сэмплинга и системными промптами.

10. Whisper.cpp

C++ реализация знаменитой модели распознавания речи OpenAI Whisper, оптимизированная для запуска на обычном потребительском железе. Позволяет с высокой точностью транскрибировать аудио и видео на десятках языков, включая русский, полностью офлайн. Whisper.cpp работает даже на CPU без GPU и отличается крайне низким потреблением ресурсов по сравнению с оригинальной Python-реализацией.

Основные возможности:

- Точное распознавание речи на 99+ языках без подключения к интернету.

- Оптимизация под CPU с использованием SIMD-инструкций (AVX2, ARM NEON).

- Поддержка всех размеров модели Whisper: tiny, base, small, medium, large.

- Пакетная транскрипция аудиофайлов, включая форматы MP3, WAV, M4A.

- Интеграция в другие проекты через C API или через Python-биндинги.

Локальный ИИ-агент: как настроить умную автоматизацию на ПК

Запускать чат с языковой моделью — это только первый шаг. Настоящая мощь локального ИИ раскрывается, когда модель перестает просто отвечать на вопросы и начинает самостоятельно выполнять многошаговые задачи.

Локальный ИИ агент — это система, в которой языковая модель наделена набором инструментов: доступом к файловой системе, браузеру, калькулятору, базам данных, внешним API. Агент планирует действия, выполняет их последовательно и корректирует план на основе результатов — все это без участия человека на каждом шаге. Например, дав агенту задачу «проанализируй все PDF-отчеты в папке и составь сводную таблицу», он последовательно откроет каждый файл, извлечет данные, структурирует их и запишет результат — и все это локально, без отправки документов в облако.

Ключевой технологией для построения таких систем является векторная база данных (RAG) — Retrieval-Augmented Generation. Смысл прост: документы разбиваются на фрагменты, каждый фрагмент превращается в числовой вектор (эмбеддинг), и все они хранятся в специальной базе. Когда поступает вопрос, система находит наиболее релевантные фрагменты и подставляет их в контекст модели — это позволяет «прокачать» языковую модель знаниями из ваших собственных документов без дообучения. Популярные векторные базы данных для локального использования, такие как ChromaDB, Qdrant и Weaviate, с открытым исходным кодом, позволяют эффективно внедрять технологию RAG (Retrieval-Augmented Generation). Это дает возможность интегрировать свои документы и базы данных в модели без необходимости в их дообучении.

Практические сценарии автоматизации становятся все более разнообразными:

- Автоматическая обработка входящей почты: классификация, черновики ответов, маршрутизация

- Кодовый агент: анализ репозитория, написание тестов, рефакторинг по команде

- Исследовательский агент: сбор данных из нескольких источников, синтез отчета

- Агент для работы с CRM: анализ клиентских данных, подготовка персонализированных предложений

- Голосовой агент: связка Whisper.cpp (распознавание речи) + LLM + TTS (синтез речи)

Наиболее популярные фреймворки для построения агентных систем — LangChain и LlamaIndex. Оба поддерживают Ollama и LM Studio как бэкенды, что позволяет строить полноценные агентные пайплайны, не отправив ни байта данных за пределы своего компьютера.

Как ускорить ИИ на компьютере: секреты квантования для максимальной скорости

Представьте, что у вас есть картина Репина во весь рост. В оригинальном разрешении она занимает гигабайты и еле открывается. Но если сохранить ее в JPEG со сжатием, она будет занимать 5 МБ, и разница почти незаметна. Вот примерно так работает квантование (Quantization) — только вместо пикселей сжимаются веса нейронной сети.

Оригинальная языковая модель хранит каждый вес в 32-битном формате с плавающей точкой (FP32), что обеспечивает максимальную точность, но и увеличивает размер модели. Например, модель Llama 3 на 8 миллиардов параметров в формате FP32 может занимать до 32 ГБ VRAM. После квантования до 4 бит тот же файл может занимать лишь ~4,5 ГБ при сопоставимом качестве работы модели, что существенно снижает требования к железу.

Стандарт формата GGUF (преемник GGML) — это современный контейнерный формат для хранения квантованных моделей, который помогает оптимизировать их размер. Название файла может содержать информацию о методе квантования: например, Q4_K_M обозначает 4-битное квантование с определенным количеством квантов и средним размером группы, что указывает на степень сжатия модели. Основные уровни квантования, с которыми вы столкнетесь:

- Q2_K — максимальное сжатие, заметная потеря качества, для очень слабого железа

- Q4_K_M — золотой стандарт: хорошее сжатие и минимальная потеря качества

- Q5_K_M — чуть крупнее Q4, чуть выше качество

- Q6_K — близко к оригинальному качеству, заметно больше размер

- Q8_0 — практически без потерь, размер вдвое меньше FP16

Помимо квантования, скорость инференса можно повысить несколькими способами. Во-первых, использовать GPU-ускорение по максимуму: в LM Studio и Ollama есть настройка «GPU layers» — количество слоев модели, выгружаемых на видеокарту. Чем больше слоев на GPU, тем выше скорость в токенах в секунду. Во-вторых, уменьшить контекстное окно: большой контекст требует больше VRAM и замедляет генерацию. Если задача не требует длинного контекста, установи его в 2048 вместо 8192 — скорость вырастет ощутимо.

На современных картах NVIDIA с тензорными ядрами скорость генерации для квантованных моделей 7B достигает 60–100 токенов в секунду — это быстрее, чем человек способен читать.

Безопасность на первом месте: почему облачные ИИ не подходят для серьезных компаний

Когда юридическая фирма отправляет проект договора в ChatGPT для анализа, эти данные покидают периметр компании. Когда медицинская клиника использует облачный ИИ для обработки историй болезней, это нарушает законодательство о защите персональных данных во многих юрисдикциях, включая GDPR и российский 152-ФЗ. Когда IT-компания прогоняет через облачные модели исходный код проприетарного продукта — она рискует утечкой интеллектуальной собственности.

Локальный искусственный интеллект полностью закрывает эту проблему. Данные физически не покидают корпоративный контур: все происходит на серверах компании или рабочих станциях сотрудников. Нет API-запросов — нет логов на внешних серверах. Нет подписки — нет зависимости от политики вендора.

Конкретные сценарии, где локальный ИИ критически важен для бизнеса:

- Юриспруденция: анализ договоров и судебной практики без риска раскрытия данных клиентов

- Медицина: обработка медицинских записей, помощь в диагностике, работа с DICOM-изображениями

- Финансы: анализ транзакций, кредитный скоринг, работа с биржевыми данными

- Разработка ПО: анализ закрытого исходного кода, поиск уязвимостей, генерация документации

- HR и рекрутинг: обработка резюме и персональных данных кандидатов

Отдельная тема — работа в условиях нестабильного или отсутствующего интернета: промышленные предприятия, военные объекты, медицинские учреждения в отдаленных районах. Здесь локальный ИИ — не роскошь, а производственная необходимость.

Важно также отметить контроль над версионированием: облачные модели обновляются без предупреждения, и то, что работало вчера, может вести себя иначе завтра. С локальными моделями вы фиксируете конкретную версию и знаете, что поведение системы не изменится без твоего ведома — критически важно для регулируемых отраслей.

Какую модель и интерфейс выбрать: полный разбор популярных решений

Ниже — сводная таблица, которая поможет быстро сориентироваться при выборе инструмента или модели:

| Инструмент | Тип задач | VRAM минимум | Скорость (t/s) | Удобство новичкам | Основное преимущество |

|---|---|---|---|---|---|

| KoboldAI | Текст, ролевые игры | 6-8 ГБ | 15-25 | ★★★☆☆ | Управление памятью персонажей |

| ComfyUI | Изображения, видео | 8-12 ГБ | 5-15 | ★★☆☆☆ | Нодовые пайплайны |

| Ollama | Текст, API | 4-16 ГБ | 30-60 | ★★★★★ | Однострочная установка |

| GPT4All | Текст, чат | 4-8 ГБ | 20-40 | ★★★★★ | Готовые модели "из коробки" |

| InvokeAI | Изображения | 8-12 ГБ | 8-20 | ★★★★☆ | Профессиональный холст |

| Stable Diffusion Web UI | Изображения | 6-16 ГБ | 10-25 | ★★★☆☆ | Тысячи расширений |

| LM Studio | Текст, мониторинг | 6-16 ГБ | 25-50 | ★★★★★ | Метрики в реальном времени |

| DeepFaceLab | Видео, deepfake | 12-24 ГБ | 2-10 | ★★☆☆☆ | Качественная замена лиц |

| Text Generation Web UI | Текст, RAG | 8-20 ГБ | 20-45 | ★★★☆☆ | Множество бэкендов |

| Whisper.cpp | Речь → текст | 2-6 ГБ CPU | 50-100+ | ★★★★☆ | Работает без GPU |

FAQ

Какая видеокарта нужна для комфортного запуска локальных нейросетей?

Для начала достаточно любой видеокарты NVIDIA с 8 ГБ VRAM — например, RTX 3070 или RTX 4060 Ti. На такой конфигурации модели 7–8 миллиардов параметров в Q4-квантовании работают со скоростью 30–50 токенов в секунду, что вполне комфортно для чата и автоматизации. Если нужна генерация изображений в SDXL или работа с моделями 13B+ — смотри в сторону 12–16 ГБ VRAM.

Можно ли запустить локальную языковую модель без видеокарты, только на процессоре?

Да, можно. Инструменты типа LM Studio и Ollama поддерживают CPU-инференс. На современном процессоре с быстрой DDR5-памятью модель 7B выдает 5–15 токенов в секунду — не молниеносно, но для фоновых задач и автоматизации вполне приемлемо. Формат GGUF и фреймворк llama.cpp специально оптимизированы для работы на CPU.

Локальные модели хуже, чем GPT-4 или Claude?

По-разному. Крупные облачные модели пока превосходят большинство локальных по качеству рассуждений и знанию мира. Но модели типа Llama 3.3 70B или Mistral Large в задачах суммаризации, написания кода, анализа документов и ролевых задачах сопоставимы с GPT-4-turbo. При этом они работают без цензуры, офлайн и бесплатно. Для большинства практических задач разрыв уже несущественен.

Что такое RAG и зачем он нужен при работе с локальными моделями?

RAG (Retrieval-Augmented Generation) — это технология, позволяющая «подключить» модель к вашей базе документов без дообучения. Система разбивает документы на фрагменты, создает из них векторные эмбеддинги и хранит в специальной векторной базе данных. При поступлении вопроса находятся наиболее релевантные фрагменты и подставляются в контекст модели. Это позволяет задавать вопросы по вашим внутренним документам, базам знаний и отчетам.

Безопасно ли использовать локальные модели без цензуры в бизнесе?

Вопрос регулирования использования ИИ актуален везде. Отсутствие встроенных фильтров в модели не означает отсутствие ответственности: бизнес сам несет ответственность за то, как используется ИИ-инструмент. Преимущество в том, что компания сама контролирует правила поведения модели через системные промпты и может настроить их точно под свои нужды — вместо того чтобы полагаться на непрозрачные фильтры облачного провайдера.

Локальные нейросети прошли путь от академических экспериментов до полноценных рабочих инструментов буквально за два года. Установить языковую модель на обычный игровой ПК — задача на пять минут, а экосистема инструментов достигла такой зрелости, что позволяет строить сложные агентные системы, полноценные пайплайны генерации изображений и системы распознавания речи — все в пределах домашней сети. Главный совет: начните с малого — поставь LM Studio или Ollama, попробуйте модель Llama 3 на 8B параметров, почувствуйте разницу с облаком. А дальше инфраструктура сама потянет вперед.

Если тема локального ИИ откликается — делитесь опытом в комментариях: какое железо используете, какие модели зашли, с какими проблемами столкнулись при настройке.

Комментарии к статье

Пока нет комментариев. Будьте первым!